作者:电子创新网编辑部

一、一个正在被回避的问题:AI 眼镜,真的需要“索尼式影像”吗?

在消费电子历史上,几乎所有涉及“影像”的终端,最终都走向了一条共识路径:大底 + 高像素 + 多帧计算 + 强 ISP + 强 SoC。

这条路径被索尼、三星以及手机厂商反复验证,并在智能手机上取得了决定性成功。

但 AI 眼镜,第一次对这套方法论提出了系统性挑战。

它不是“缩小版手机”,而是一种全天佩戴、持续感知、能量极度受限的设备形态。

在这里,影像系统的第一目标不再是“拍得多好”,而是:在尽可能低的功耗下,持续获取足够“可被理解”的环境信息。

当评价体系改变,传统影像方案的优势,反而开始变成负担。

二、索尼路线的问题,不在技术,而在假设前提

必须承认,在 CMOS 技术本身,索尼依然代表着行业天花板。但其影像路线隐含着几个在 AI 眼镜中不成立的前提假设。

假设一:影像是“被触发”的,而非“常开”的

索尼体系的核心假设是:

影像采集是阶段性的,系统可以为此短时间“全力以赴”。

这在手机拍照、工业检测、专业 XR 中完全成立,却与 AI 眼镜的使用逻辑相冲突——AI 眼镜需要的是低频但持续的环境感知,而不是高峰值性能。

假设二:算力与功耗可以通过系统级调度解决

多帧 HDR、复杂 ISP 管线、强 SoC 协同,本质上是用系统算力换取成像质量。

但在百毫安时级电池、毫米级模组空间的 AI 眼镜中,这种“后端解决问题”的方式成本极高。

假设三:画质优先于信息密度

在 AI 眼镜中,算法关心的并不是照片是否“好看”,而是:

轮廓是否稳定

明暗是否可区分

画面是否足够可靠地支撑识别与触发

这意味着,单位能耗下的信息密度,比极限画质更重要。

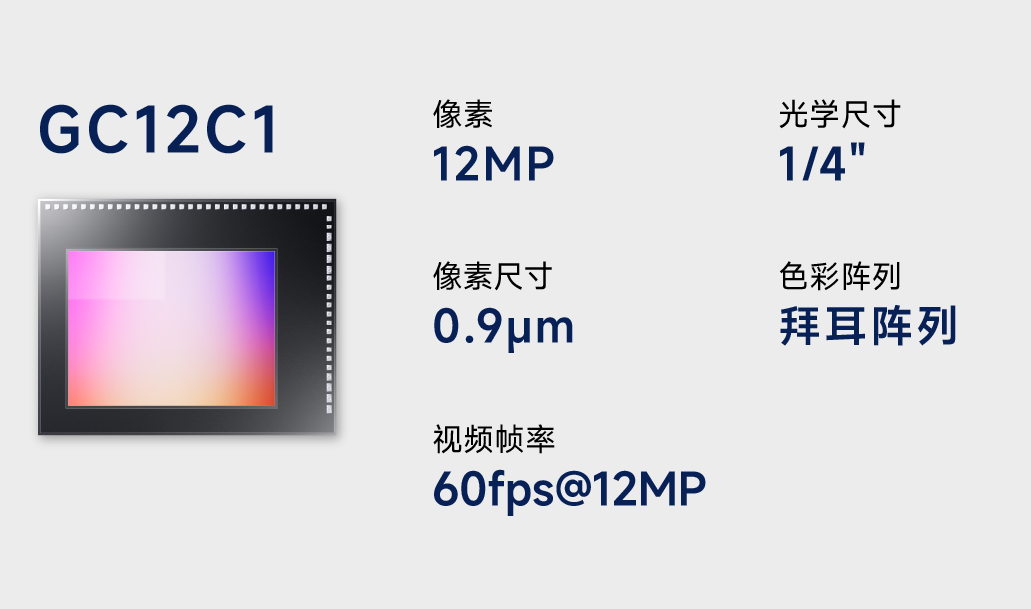

三、GC12C1 的意义:不是挑战索尼,而是绕开索尼

在这样的背景下,格科微 GC12C1 的设计思路显得异常清晰:它并不试图在“影像巅峰”与索尼竞争,而是选择了另一条起点。

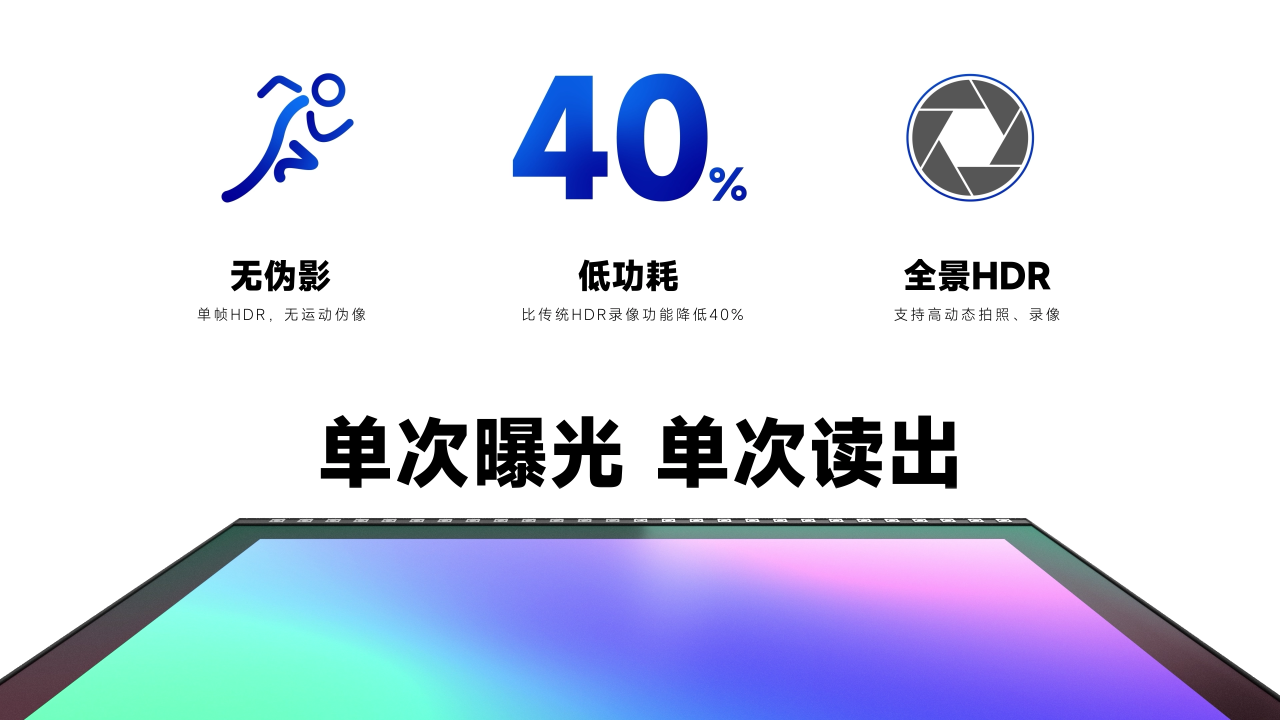

1. 单帧 DAG HDR:否定“多帧一定更好”

GC12C1 采用的 DAG HDR,本质上是单帧、像素级双转换增益读出方案。

这在手机影像语境中并不前沿,但在 AI 眼镜中却击中了关键痛点:

无多帧合成 → 无运动伪影

单次曝光 → 更低算力依赖

传感器侧完成动态范围获取

这不是“性能取胜”,而是架构取胜。

2. AON 常开感知:把“是否唤醒系统”的决定权前移

GC12C1 的 AON 模式,并非简单的低功耗待机,而是允许传感器在毫瓦级功耗下持续输出基础视觉信息。

这意味着:

系统不必为“是否有重要事件”频繁唤醒

传感器开始承担“感知哨兵”的角色

与索尼“高性能感知 + 系统处理”的模式相比,格科微选择的是:感知前置,算力后移,系统保持克制。

3. 小尺寸下的噪声控制:承认物理限制,而非对抗它

索尼的优势路径,往往是通过更大靶面获取更高信噪比。而在 AI 眼镜中,这条路几乎被彻底封死。

GC12C1 通过像素隔离与工艺优化,在小尺寸条件下压低读出噪声,本质上是一种向现实妥协、但不放弃优化空间的工程选择。

四、这不是“国产替代”,而是“形态更替”

如果继续用“国产 vs 国际大厂”的叙事框架解读 GC12C1,反而会低估它的价值。

更准确的说法是:AI 眼镜,正在把图像传感器从“影像赛道”,拉进“感知赛道”。

在这个赛道里:

传感器不再只是被动输入

而是系统功耗、算力分配的决策节点

索尼并非做不到这一点,而是其既有体系并非为此而生。

五、结论:AI 眼镜时代,索尼仍然很强,但不一定“最合适”

GC12C1 所代表的,并不是一次对索尼技术实力的正面挑战,而是一种对影像方法论的重新排序:

在 AI 眼镜中

“常开、低功耗、可用信息”优先于极限画质

这正是国产传感器厂商在新形态终端中,最有机会建立话语权的地方。

如果说手机时代的赢家属于“谁能把影像做到最好”,

那么 AI 眼镜时代,赢家可能属于:

谁最先接受:影像不再是终点,而只是感知链路的起点。

* 本文为原创文章,转载需注明作者、出处及原文链接,否则,本网站将保留追究其法律责任的权利。